使用在线模型时是否经常遇到

此时就需要搭建一个本地模型,即使断网也可以使用

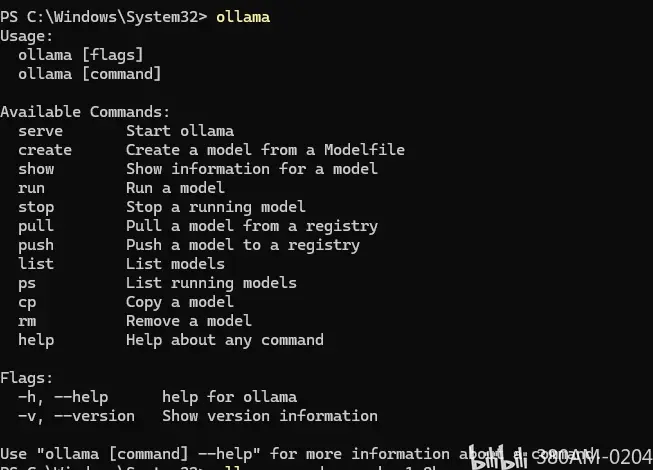

先下载安装ollama(链接:https://ollama.com/)

安装好后cmd输入ollama

如果不是这样的,就是没有安装成功

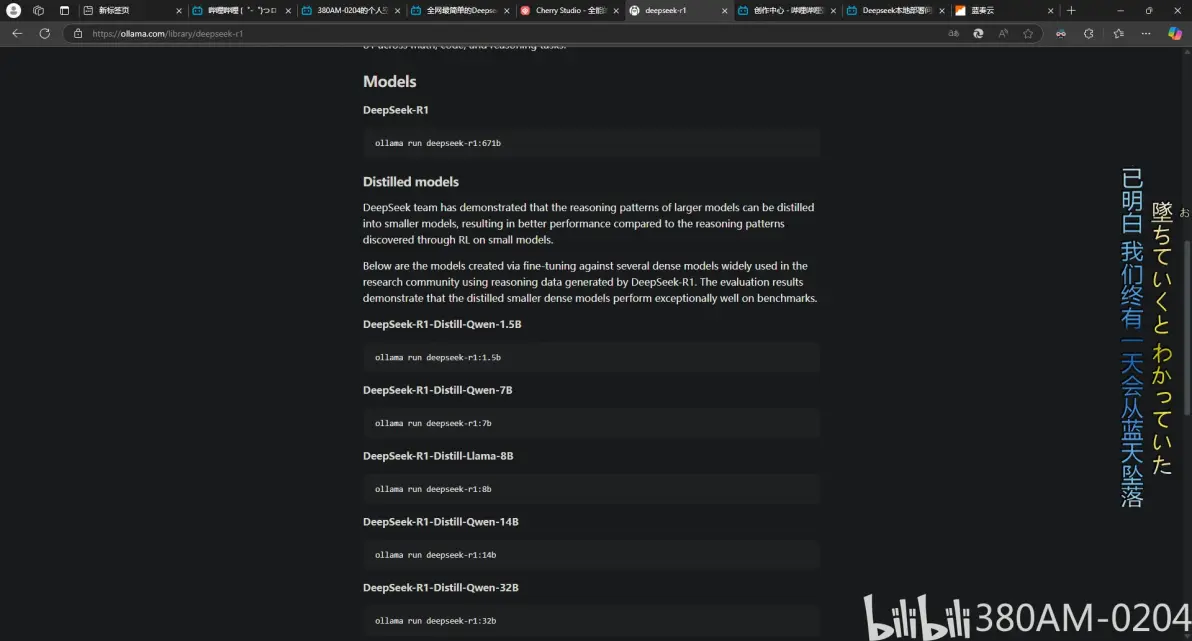

到https://ollama.com/library/deepseek-r1下载DppeSeek R1模型,显卡内存在4GB-8GB的建议使用7b或8b(越大参数量越多,同样体验更好)

往下滑找到

选择一个适合你的硬件模型下载

下载时如果速度下降(到1MB/s左右)可以按ctrl+c结束下载,再重新输入命令,就可以继续下载了(从刚刚结束的位置开始重新下载)不行就可以多重复几次,千兆宽带实测下载速度可以到50MB/s左右,最慢的时候甚至可以到几十kb (某网盘)

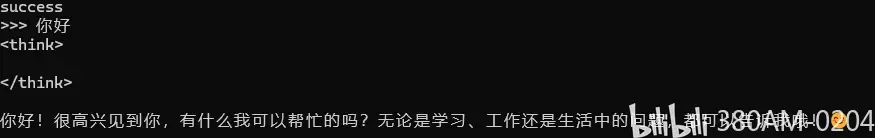

下载完成后,大概率就能直接使用了

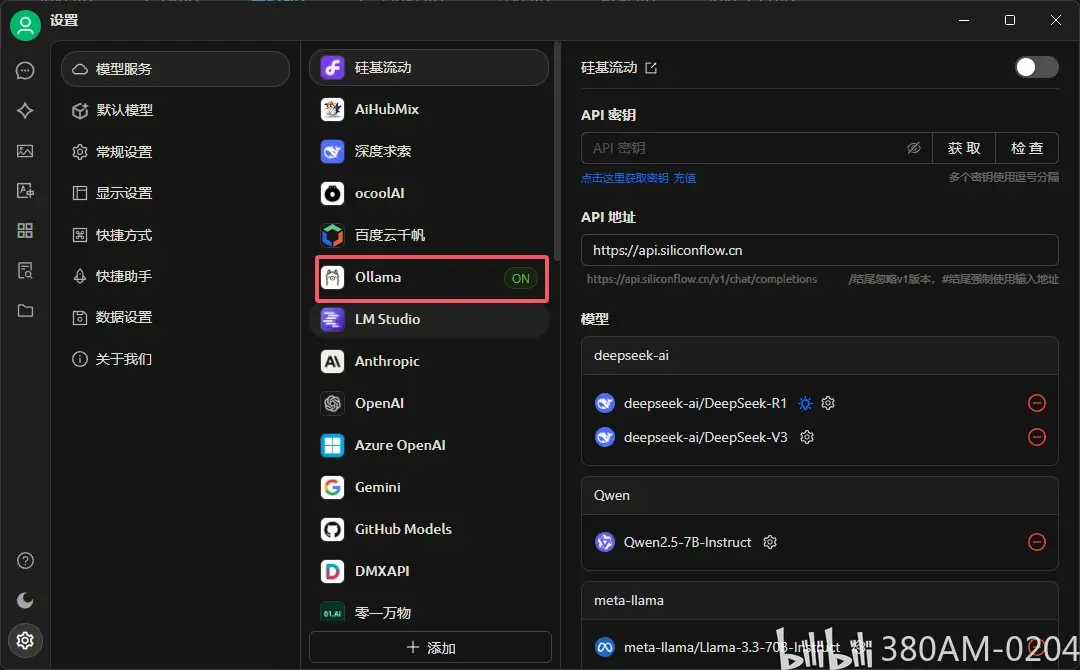

但是没有图形化的界面未免不太好看,所以可以安装一个Cherry Studio

链接:https://cherry-ai.com/download

直接下载就可以

设置里面就可以看到ollama的模型

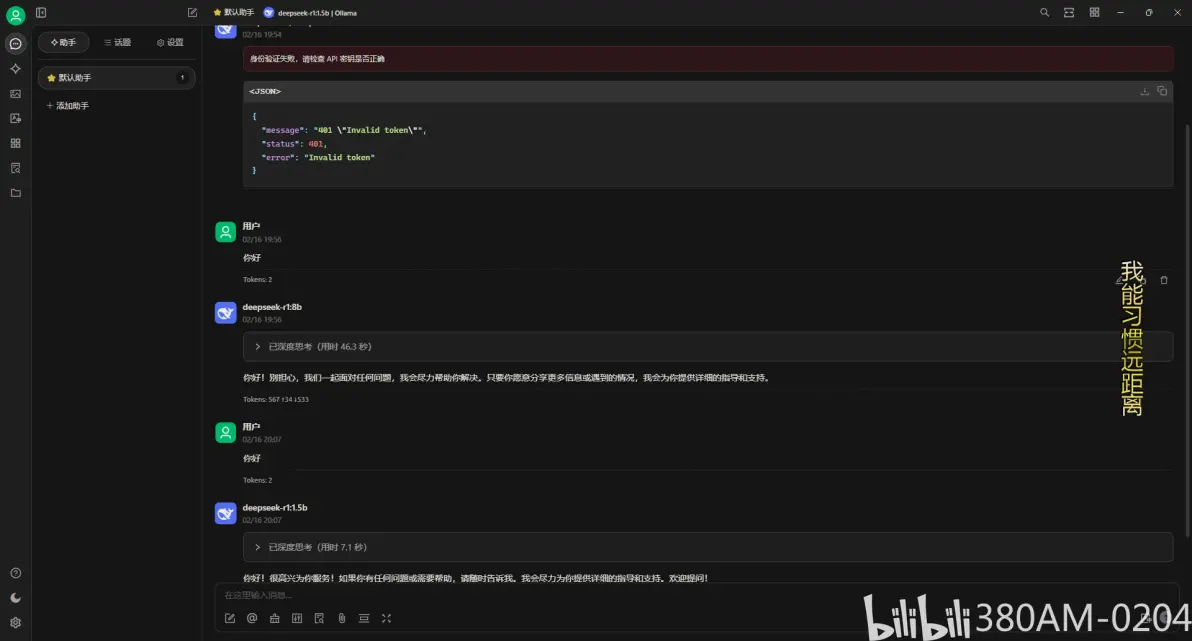

之后返回到主页,切换成刚刚创建的模型就可以了

我使用的是R5 3600+RX580 2304sp 8GB(内存16GB),运行8b模型时思考需要较长时间(大约45秒)但1.5b速度就很快了

本博客所有文章除特别声明外,均采用

CC BY-NC-SA 4.0

许可协议。转载请注明来自380AM-0204 !

评论

评论